11月12日下午14:00至15:30,電院舉辦了一場主題為 “對時態數據的分析與預測”的網絡研討會:由享譽國際的Hamido Fujita教授主講🪓🗓,講座重點介紹了深度序列建模(DSM)的最新發展,以及它在徹底改變自然語言處理(NLP)和時間序列預測等涉及序列數據的任務方面的潛力。

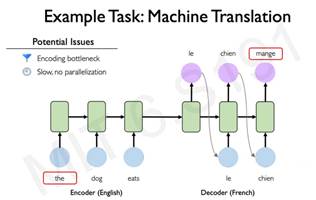

深度學習在各個領域都取得了重大突破,但對許多傳統方法來說,序列數據建模--特別是捕捉長期依賴關系和復雜的時間模式--仍然是一個挑戰☝🏿。在本講座中🧑🏽⚕️,Hamido Fujita教授介紹了 DSM,作為應對這些挑戰的強大解決方案。DSM 的核心思想是使用深度學習架構,如遞歸神經網絡 (RNN)🧜🏽♂️、變形器和註意力機製,這些架構專門用於捕捉連續數據中錯綜復雜的時間動態⛅️。

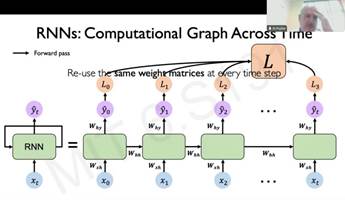

Hamido Fujita教授在講座中詳細解釋了RNN(循環神經網絡)如何通過在每個時間步共享相同的權重矩陣👩🍳👨🏻,來增強模型在處理序列數據時的長程依賴性建模能力。RNN能夠通過在時間維度上遞歸傳遞信息👳🏽♀️,捕捉到序列中長期的上下文關系🖐🏻,這使得模型能夠理解和預測隨時間變化的復雜模式🤳🏻,從而提高預測的準確性。尤其是在處理從語音識別到金融預測等各種序列任務時🚶♂️,RNN表現出了極大的靈活性和適應性🎪。此外🧙,Hamido Fujita教授還強調了RNN相較於傳統深度學習模型的優勢,特別是在高效處理時間序列數據時,RNN能夠通過共享權重矩陣和在每個時間步上更新隱藏狀態,提升了模型在長序列數據中的表現。這種結構不僅提高了模型在序列數據上的計算效率,還使得RNN在不同長度的序列任務中都能提供更高的準確性和更強的泛化能力。

在本講座中🥚,Hamido Fujita教授介紹了標準RNN模型在處理序列數據時面臨的挑戰,並提出了應對這些問題的解決方案。教授解釋了在RNN的梯度計算過程中🛎😡,尤其是涉及到多個時間步的計算時🧑⚕️🤸🏼♂️,梯度爆炸問題的產生。由於RNN模型在每個時間步都會涉及到先前隱藏狀態的遞歸計算👂🏼,這導致了梯度可能隨著時間的推進而不斷增大✍🏿🔦,最終造成訓練的不穩定性。為了克服這一問題,教授介紹了“梯度裁剪”技術🤷🏻♂️,該方法能夠有效控製梯度的大小🧜🏽♂️,防止梯度爆炸,確保模型訓練過程的穩定性🏍。

此外,教授還強調了RNN及其變種,如LSTM和GRU👈,作為處理長序列數據和捕捉時間動態的重要工具,這些模型能夠較好地解決傳統神經網絡在處理長程依賴時的困難🧍。通過這些深度學習架構的創新,RNN和相關技術能夠在語音識別🤟、金融預測等領域展現出更強的能力。

與會師生通過騰訊會議參與講座,深入了解了Hamido Fujita教授對深度序列建模(DSM)及相關知識的獨特見解。聽眾就這些內容展開了熱烈討論🥋,並對深度強化學習的未來發展有了更深的認識。本次講座也為人工智能領域的研究者提供了一個共享思想和經驗的機會✌🏿。