近日🏇🏿🏌️,恒达平台“融合計算和位置服務”科研團隊的骨幹老師朱海博士指導2022屆碩士研究生呂鴻祥在地球科學和遙感領域頂級期刊《IEEE Transactions on Geoscience and Remote Sensing(IF=8.2,中科院一區TOP期刊)》發表了題為“Direction-Guided Multi-Scale Feature Fusion Network for Geo-localization”的學術論文。IEEE TGRS是地球科學和遙感領域的頂級期刊之一🧗🏻♀️,是IEEE地球科學與遙感技術協會(GRSS)會刊,在遙感技術和地球科學領域具有較高影響力。恒达娱乐為該論文第一署名單位和通訊單位🏃🏻♂️➡️。

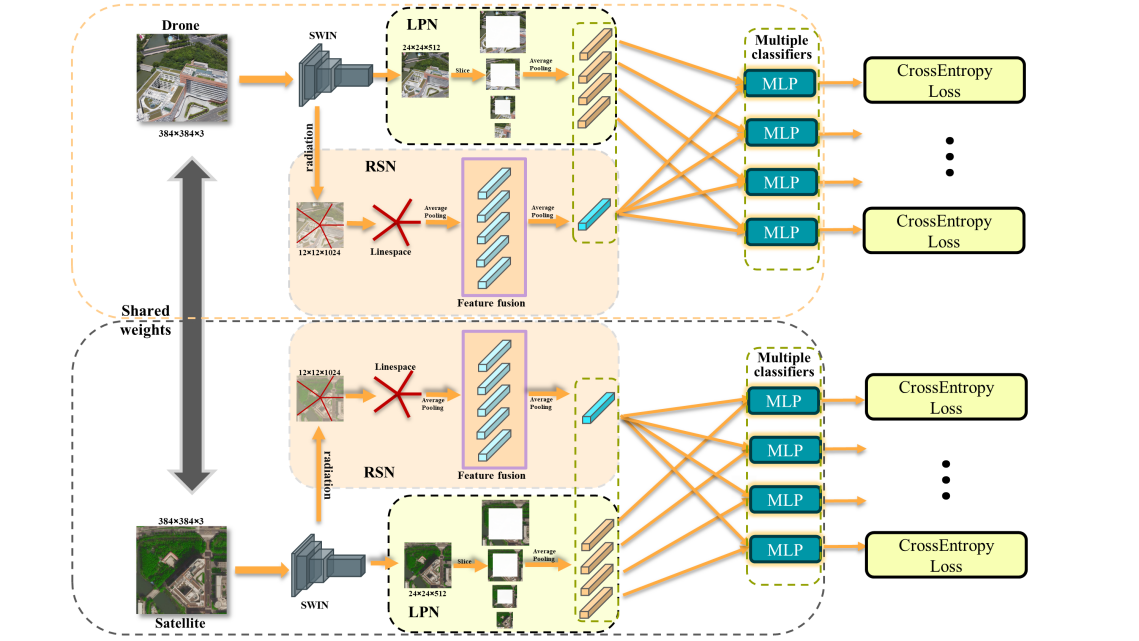

圖1 新型的win-Radial-Locality Network跨視圖地理定位網絡

該研究成果突破了跨視角地理定位技術中方向性特征難以獲取的限製💂🏻♀️🤷🏿♀️,提出了一種新型的跨視圖地理定位網絡(如圖1)🦬,稱為Swin-Radial-Locality Network (SRLN),有效提高了從不同視角獲取的圖像之間的匹配精度𓀓。在地理定位技術的發展過程中,實現精準高效的跨視角景象匹配一直是一個世界性挑戰。無人機和衛星圖像之間由於存在明顯的視角差異,給地理定位帶來了巨大困難🙌🏼,傳統的圖像檢索方法往往難以準確捕捉這些視角之間的差異,導致定位性能不佳。為了突破這一瓶頸,團隊經過大量深入研究☃️,提出了一種新穎的SRLN框架,通過先進的圖像處理技術,將多尺度特征融合和方向信息處理融入地理定位流程🐝,從根本上增強了對不同視角圖像特征的建模能力®️。該項創新性研究工作有力突破了傳統地理定位方法的局限,為解決無人機和衛星圖像的精確匹配問題貢獻了全新的思路🤵🏻♂️。

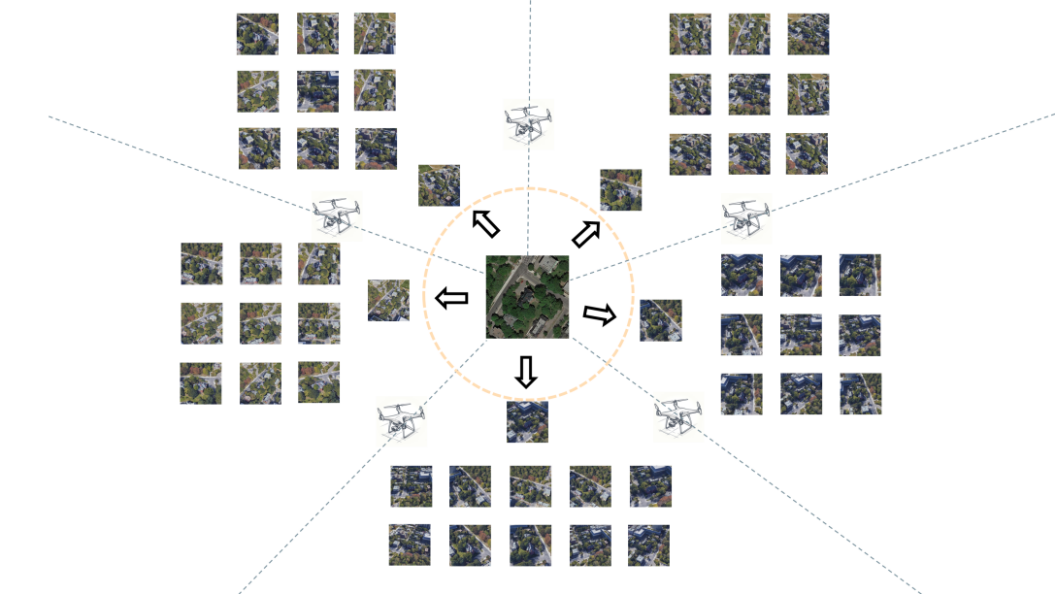

本論文中所使用的SUES-200數據集是恒达平台“融合計算和位置服務”科研團隊針對空地景象匹配的重要基礎性成果,其目標是為了更好地幫助合理評價各類景象匹配算法優劣的情況🧝🏻,從而提出的一個開源標準測試benchmark🫅。該研究前期研究成果已發表在知名期刊IEEE Transactions on Circuits and Systems for Video Technology上,是由團隊的2021屆碩士研究生朱潤哲完成並發布,論文名稱“SUES-200: A Multi-height Multi-scene Cross-view Image Matching Benchmark Across UAV and Satellite”,其數據是為跨視圖圖像匹配特別設計,涵蓋了多種高度和場景的無人機與衛星視圖,見圖2💉。

圖2 SUES-200數據集的數據跨視圖圖像采集與設計原理圖

這項跨視圖地理定位技術形成的SUES-200數據集對於視角差異導致的圖像變形方面的處理表現出色,極大地提高了地理位置識別的準確性和效率,為遙感圖像分析和地理信息系統的發展貢獻了新的思路和方法,從而在城市規劃、災害監測和應急響應等領域具有廣泛的應用潛力🏄🏻♂️,展示了我校在地理信息系統領域的研究實力。目前⌨️,“融合計算和位置服務”科研團隊以此為基礎🐞,已先後發表多篇高水平科研論文,獲得全國大學生“挑戰杯”國家一等獎🫃🏼,爭取到上海市科委重大項目,並且被上海眾多研究機構🔡,以及武漢大學測繪重點實驗室所關註和應用🫲🏻🦂,團隊希望今後能夠進一步擴展開源數據集👯♂️,形成泛化能力更強、測試針對性更高🐛、數據代表性更豐富的系列“SUES-XXX”📡🤭,能夠在更多實際環境中得到應用和推廣。